EU AI Act 2026

Was Provider und Deployer jetzt wissen müssen

KI rechtskonform und zukunftssicher einsetzen? Das gehört sicher zu den großen unternehmerischen Herausforderungen im Jahr 2026. Mit uns behältst du den Überblick

Die Einführung des EU AI Acts markiert einen Meilenstein für den verantwortungsvollen Einsatz von Künstlicher Intelligenz in Europa. Ziel ist es, den Einsatz von KI-Systemen klar zu regulieren und gleichzeitig Innovationen zu fördern. Dabei werden KI-Systeme nach ihrem Risiko für Grundrechte, Sicherheit und Gesundheit von Menschen in vier Risikoklassen eingeteilt: unannehmbares Risiko, hohes Risiko, begrenztes Risiko und minimales Risiko. Systeme mit unannehmbarem Risiko, wie Überwachung am Arbeitsplatz oder Social-Scoring-Systeme, sind verboten. Hochrisiko-Systeme, etwa in Medizin, Verkehr oder sicherheitskritischen Bereichen, unterliegen umfassenden Pflichten. Diese reichen von technischer Dokumentation über Notfallprozeduren bis zur Hinterlegung in der EU-Datenbank.

Ein zentraler Punkt des EU AI Acts ist die Förderung von KI-Kompetenz im Unternehmen.

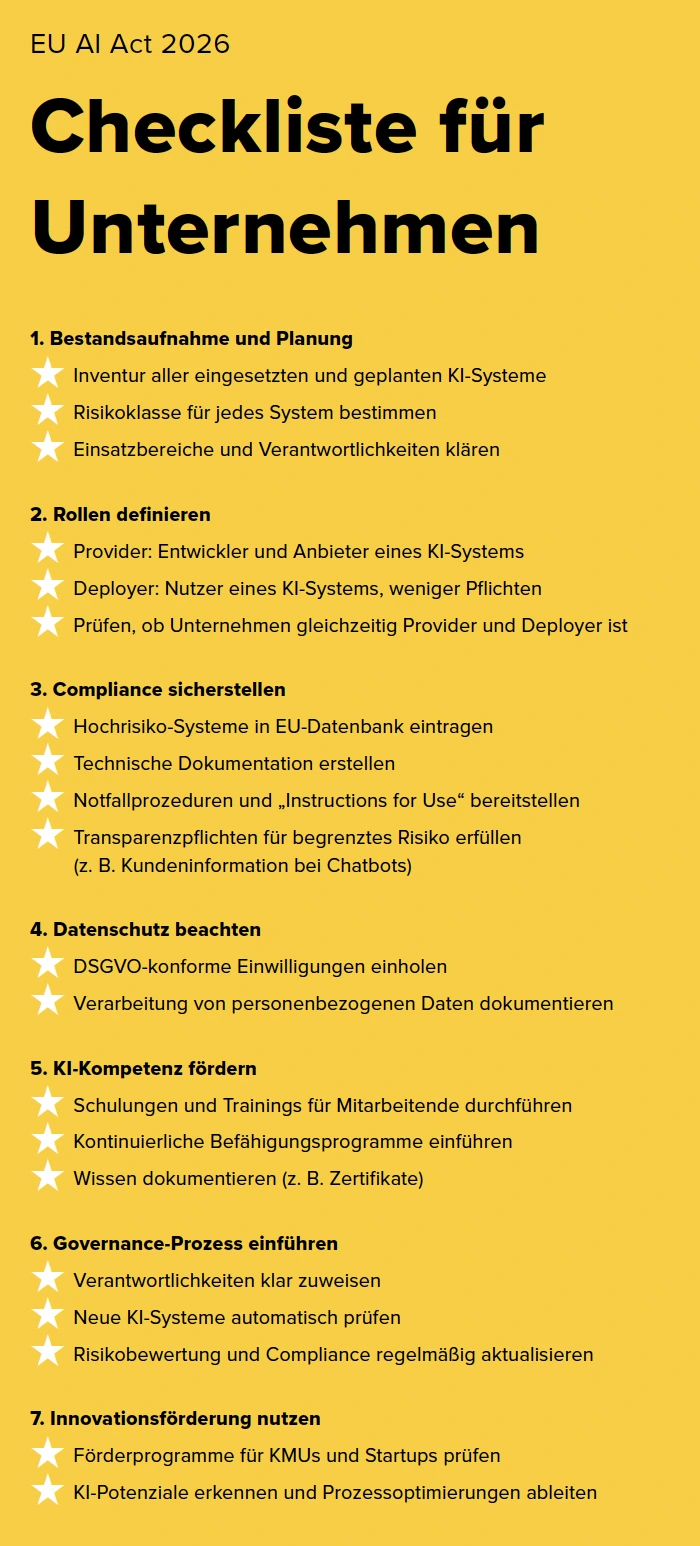

Ebenfalls von Bedeutung ist die Rolle eines Unternehmens: Als Provider entwickelt man ein KI-System und bringt es unter eigenem Namen oder Marke auf den Markt. Provider müssen umfassende Pflichten erfüllen, darunter die Bereitstellung von „Instructions for Use“ und die Einordnung in die Risikoklasse. Deployer hingegen nutzen KI-Systeme, die von einem Provider bereitgestellt werden. Sie tragen weniger Pflichten, müssen aber die Nutzung im Rahmen der Vorgaben sicherstellen. In komplexen Fällen kann ein Unternehmen sowohl Provider als auch Deployer sein, was die Pflichten verdoppelt.

Unternehmensrichtlinien besser einführen

Für KI-Systeme mit begrenztem Risiko, wie Customer-Service-Chatbots, liegt der Fokus auf Transparenz und Offenlegung. Nutzer müssen informiert werden, dass sie mit einer KI interagieren und welche Daten verarbeitet werden. Hier greifen teilweise auch DSGVO-Regeln, etwa für die Einholung von Einwilligungen. Systeme mit minimalem Risiko erfordern keine spezifischen regulatorischen Maßnahmen, dennoch wird empfohlen, freiwillig Governance-Strukturen, Logging, technische Dokumentation und ethische Leitlinien einzuführen.

Ein zentraler Punkt des EU AI Acts ist die Förderung von KI-Kompetenz im Unternehmen. Anbieter und Betreiber müssen Maßnahmen ergreifen, damit ihr Personal über ausreichende Kenntnisse im Umgang mit KI verfügt. Dazu gehören Schulungen zur Minimierung von Risiken wie IP-Leaks oder Datenverlust, aber auch zur Potenzialerkennung für Prozessoptimierungen. Auch wenn Zertifikate und Nachweise aktuell nicht verpflichtend sind, helfen sie im Schadensfall die Verantwortlichkeit zu belegen und die Compliance nachvollziehbar zu dokumentieren.

Und in der Praxis?

Unternehmen sollten zunächst eine Bestandsaufnahme aller KI-Systeme durchführen, bestehende und geplante Systeme analysieren und sie nach Risikoklasse einordnen. Workshops und digitale Tools wie Compliance-Checker können helfen, Rollen, Pflichten und Risiken zu identifizieren. Systeme mit limitiertem oder minimalem Risiko bilden die Mehrheit, sodass viele Unternehmen zunächst nur wenige der Hochrisiko-Pflichten umsetzen müssen.

Es empfiehlt sich, Governance-Prozesse einzuführen

Darüber hinaus empfiehlt es sich, Governance-Prozesse einzuführen, die die Bewertung neuer KI-Systeme erleichtern und Verantwortlichkeiten klar definieren. Dies unterstützt nicht nur die Compliance, sondern auch die strategische Nutzung von KI in allen Geschäftsbereichen. Der EU AI Act bietet damit Klarheit über zulässige Anwendungen, Pflichten und Risiken – eine Voraussetzung, um Innovationen gezielt zu fördern, ohne Grundrechte zu gefährden.

Die klare Einordnung nach Risikoklassen sowie die Schulung der Mitarbeiter schaffen Transparenz, minimieren Risiken und fördern die Potenziale von KI. Unternehmen können so den sicheren und verantwortungsvollen Einsatz von KI gewährleisten, ohne ihre Innovationskraft zu bremsen.

EU AI Act 2026 – Risikoklassen und Pflichten

Unannehmbares Risiko

z. B. Überwachung am Arbeitsplatz

Hochrisiko

z. B. Medizin, Verkehr

Pflichten:

– Technische Dokumentation

– Notfallprozeduren

– Hinterlegung in EU-Datenbank

Begrenztes Risiko

z. B. Customer-Service-Chatbots

Pflichten:

– Transparenz

– Offenlegung

Minimales Risiko

z. B. Spamfilter

– Keine spezifischen Maßnahmen

.webp)